Verwendung von EasyAR-Beispielen auf XR-Headsets oder Brillen

EasyAR bietet einheitliche Beispiele für alle Headsets, die ohne Code auskommen und vollständig durch Konfiguration in der Szene realisiert werden. Die Verwendung der Funktionen selbst kann anhand der entsprechenden Beispielimplementierungen auf Android/iOS-Handys nachvollzogen werden.

Die Beispielnamen für Headsets lauten Combination_BasedOn_*, z.B. ist das Beispiel für Pico Combination_BasedOn_Pico. Dieses Beispiel demonstriert die meisten EasyAR-Funktionen in einer Szene, die dynamisch ein- und ausgeschaltet werden können, einzeln oder gleichzeitig.

Vorbereitungen

- Stellen Sie sicher, dass Ihr Headset oder Ihre Brille in der EasyAR Unterstützungsliste aufgeführt ist

- Laden Sie das EasyAR Unity-Plugin-Paket herunter und importieren Sie es

- Laden Sie das EasyAR Unity XR-Geräteerweiterungspaket herunter und importieren Sie es

- Beschaffen Sie eine für XR-Headsets oder Brillen geeignete EasyAR-Lizenz. Verfügbare Lizenztypen umfassen:

- EasyAR Sense 4.x XR-Lizenz Testversion (Test, selbst aktivierbar auf der EasyAR-Website)

- EasyAR Sense 4.x XR-Lizenz Vollversion (kostenpflichtig nach Bezahlung, kontaktieren Sie den Vertrieb)

- EasyAR Sense 4.x XR-Lizenz Enterprise-Version (für Enterprise-SDKs)

Vorsicht

Auf Headsets und Brillen darf ausschließlich die XR-Lizenz verwendet werden. Normale Lizenzen aktivieren EasyAR-Funktionen nicht.

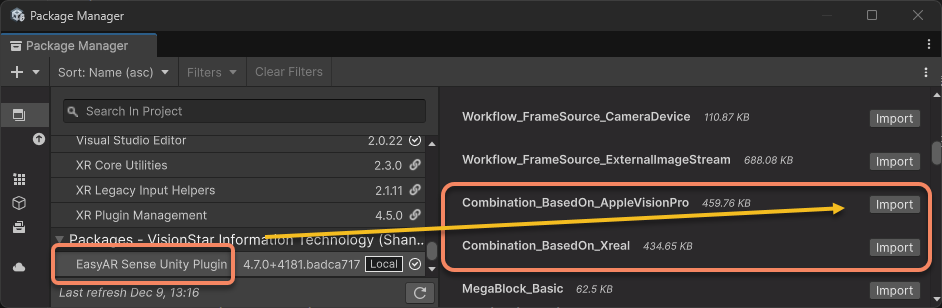

Importieren der offiziellen Beispiele

Beispiele für nativ unterstützte Geräte befinden sich im EasyAR Unity-Plugin-Paket. Importieren Sie die benötigten Beispiele je nach Gerät separat.

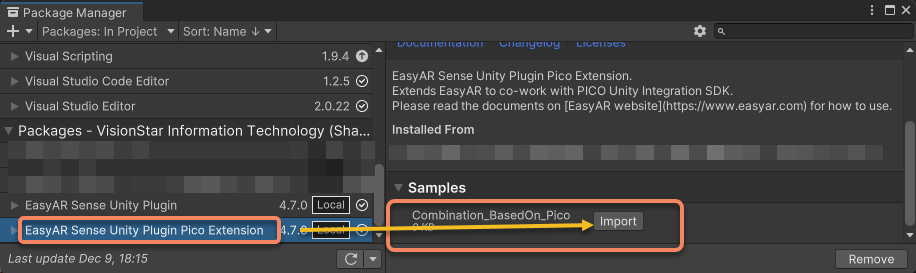

Beispiele für per Erweiterung unterstützte Geräte werden mit der entsprechenden Headset-Erweiterung ausgeliefert. Importieren Sie die Beispiele mit Unity in Ihr Projekt. Beispiel für Pico:

Beispiel-Build und Ausführung

Führen Sie die Headset-Projektkonfiguration und die Beispielanleitung separat durch.

Befolgen Sie strikt die offizielle Dokumentation und Anleitung des jeweiligen Headset-Herstellers für die Konfiguration. Die EasyAR-Dokumentation deckt diese Inhalte nicht ab.

Führen Sie die Konfiguration gemäß den Plattformhinweisen in der EasyAR-Dokumentation durch.

Android: Siehe Android-Projektkonfiguration

visionOS: Siehe visionOS-Projektkonfiguration

XREAL: Zusätzlich zu den Android-Einstellungen ist die XREAL-Projektkonfiguration erforderlich.

Erstellen des Beispiels Erstellen Sie das Beispiel in Unity und stellen Sie es auf dem Gerät bereit. Details finden Sie unter Beispiele in Unity ausführen.

Verwendungshinweise

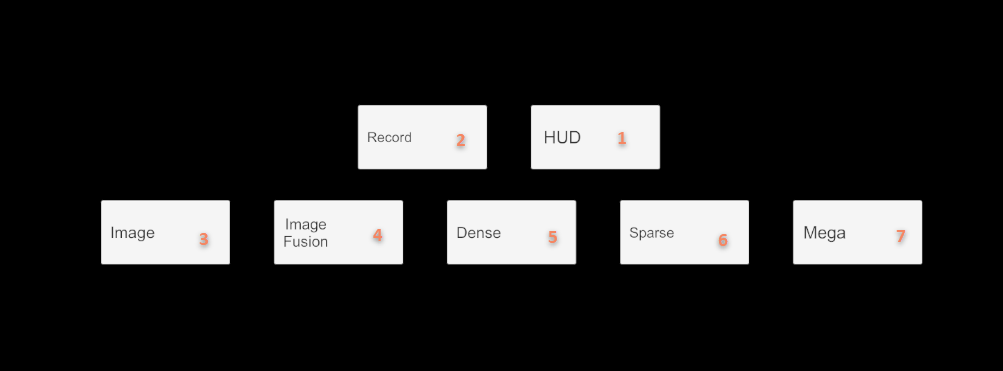

Das Beispiel enthält mehrere Schaltflächen mit folgenden Funktionen.

- Schaltfläche 1

HUD: Schaltet den UI-Anzeigemodus um. Im Ausgangszustand ist die UI in der realen Welt fixiert. Nach Aktivierung des HUD wird die UI stets im Sichtfeld angezeigt. - Schaltfläche 2

Record: Aktiviert/deaktiviert die EIF-Aufzeichnung. Nach dem Einschalten muss sie ausgeschaltet werden, um eine normale EIF-Datei zu erstellen. Andernfalls ist die Datei unbrauchbar. - Schaltfläche 3

Image: Schaltet die Bildverfolgung ein/aus. - Schaltfläche 4

Image Fusion: Schaltet den Bildverfolgungs- plus Bewegungsfusionsmodus ein/aus. - Schaltfläche 5

Dense: Schaltet die Erstellung dichter räumlicher Karten ein/aus. - Schaltfläche 6

Sparse: Schaltet die Erstellung spärlicher räumlicher Karten ein/aus. - Schaltfläche 7

Mega: Schaltet Mega ein/aus.

Funktionsdetails

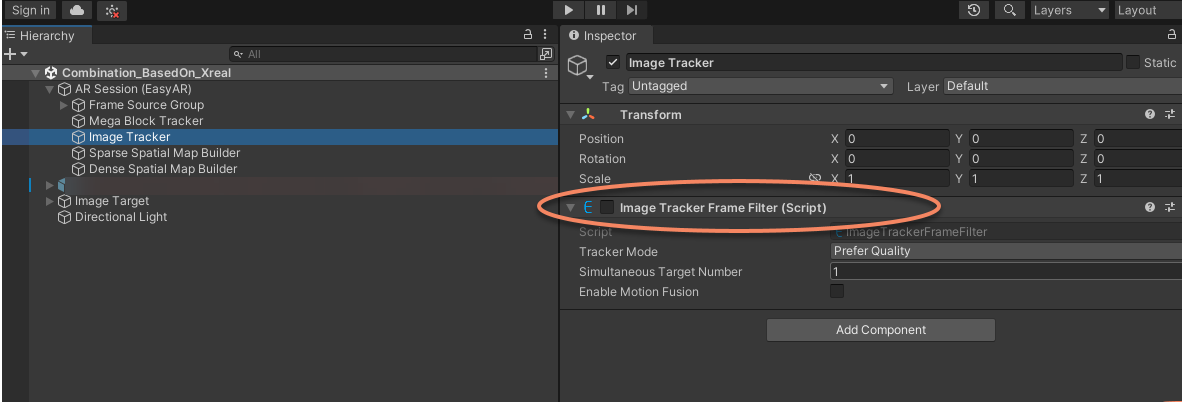

Standardfunktionsschalter

Alle Funktionen sind beim Start standardmäßig deaktiviert. Dies wird durch Deaktivieren der entsprechenden Skripte im Editor erreicht. Die Schaltflächen aktivieren/deaktivieren diese Skripte. Sie können die standardmäßig aktiven Funktionen basierend auf Ihrem konkreten Anwendungsfall festlegen.

Koordinatenursprungsreferenz

Im Beispiel befindet sich am Ursprung des Koordinatensystems der Bewegungsverfolgung ein statisches Pandamodell zur Überprüfung des Bewegungsverfolgungsstatus. Dieses Modell hilft bei der Problemisolierung. Beispielsweise kann es bei der Verwendung von Mega zu schnellem Drift kommen, der durch die Bewegungsverfolgung des Geräts (also einen Gerätedefekt) verursacht wird. In diesem Fall bewegt sich auch das Pandamodell mit. Sie können dieses Modell bei Bedarf anpassen oder entfernen.

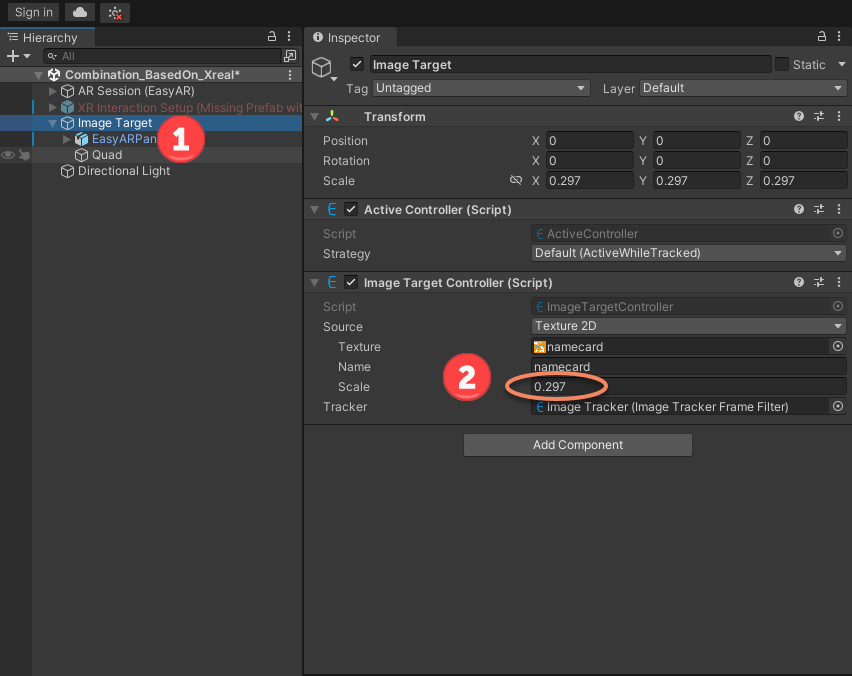

Verwendung der eingebetteten Erkennungsgrafik für die Bildverfolgung

Das Beispiel hat eine Größe für die verwendete Grafik der ebenen Bildverfolgung voreingestellt. Sie müssen namecard.jpg auf A4-Papier drucken, wobei das Bildverhältnis unverzerrt und unbeschnitten bleiben muss. Füllen Sie das Papier möglichst vollständig aus (siehe Abbildung).

Messen Sie die gedruckte Länge des Namenskartenmotivs auf dem Papier. Basierend auf dem Messergebnis muss der

Scale-Wert desImage Targetin der Unity-Szene auf die tatsächliche physikalische Größe eingestellt werden (Einheit: Meter).

Wenn

EasyAR Bewegungsfusionaktiviert ist, können nur Bilder an festen Positionen (unbeweglich) verfolgt werden. Ist die Bewegungsfusion deaktiviert, kann das Bild nicht mehr verfolgt werden, sobald es außerhalb des Sichtfelds liegt.Manchmal kann die Brillenperspektive die tatsächliche Kamerabildgröße nicht korrekt wiedergeben. Bei Erkennungsproblemen versuchen Sie, die Brillenkamera näher an das Bild zu bringen. Für praktische Anwendungen wird empfohlen, größere Bilder (z.B. 5m x 5m) zu verfolgen.

Anmerkung

Auf Headsets muss der Scale-Parameter des image target unabhängig vom Aktivierungszustand der EasyAR-Bewegungsfusion auf die tatsächliche physikalische Größe gesetzt werden. Andernfalls ist die Anzeigeposition fehlerhaft.

Mega-Konfiguration

Wenn Sie EasyAR Mega verwenden, lesen Sie bitte Mega Unity-Schnellstart.